Uma máxima na área de machine learning diz que precisamos de dados de qualidade para que um algoritmo alcance um bom desempenho. “Garbage in, garbage out”, ou seja, dados ruins resultam em um modelo ruim. Mas além de serem treinados com dados de qualidade, os algoritmos costumam também ser testados com dados que passaram por algum processo de limpeza e padronização. Só que, em muitas áreas de aplicação, esta não é a realidade prática. Um carro autônomo, por exemplo, vai ter que reagir às informações imperfeitas que recebe durante sua navegação no ambiente. Mesmo que tenha sido treinado com os melhores dados possíveis, no seu dia-a-dia operacional, os sensores podem falhar, ou podem ocorrer obstruções entre os sensores e as informações ambientais que eles tentam capturar, que resultam em entradas chamadas de adversariais para o modelo, as quais por sua vez comprometem as decisões que o veículo deve tomar. Este é ainda, um exemplo de um caso crítico, pois é essencial que um veículo autônomo tome decisões seguras mesmo que receba dados não ideais.

Um trabalho publicado em fevereiro por pesquisadores do Instituto de Tecnologia de Massachusetts (MIT, Estados Unidos) trata deste problema específico. Eles desenvolveram um protocolo, batizado de CARRL, para, como explicita o título do artigo, certificar a robustez de redes neurais de aprendizagem por reforço frente a incertezas de natureza adversarial. A ideia é permitir aos algoritmos considerar um elemento de incerteza nos dados que recebem, ou adicionar um nível saudável de ceticismo, e assim habilitá-los a retornar uma resposta considerando o pior cenário possível dentro do nível de incerteza reconhecido.

O método foi desenvolvido em cima de um protocolo de treinamento de uma rede de aprendizagem por reforço do tipo Q, ou DQN, que associa as entradas com um valor Q de recompensa. Os dados de entrada são perturbados e a rede deve aprender a determinar a melhor ação que resulta na recompensa ótima diante do pior cenário, representado pelas perturbações que comprometeriam de forma mais grave seu desempenho.

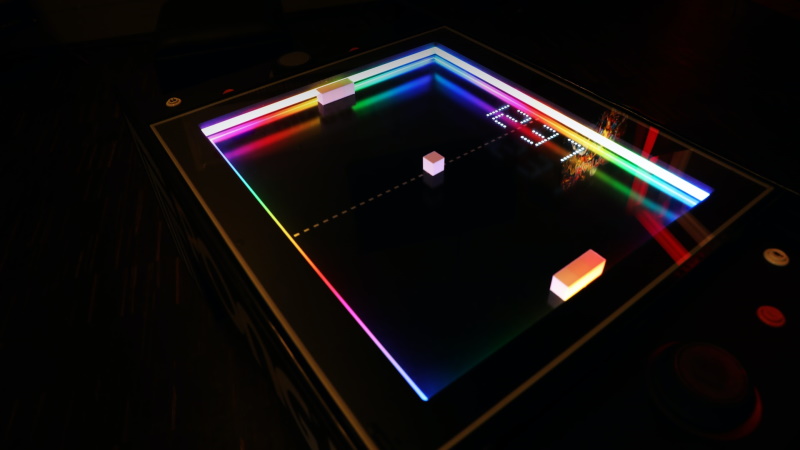

Entre os cenários em que o método CARRL foi testado, um envolveu uma tarefa virtual onde dois agentes deveriam trocar de posição sem a ocorrência de colisões; o elemento de incerteza foi adicionado em relação à posição de um dos agentes. O outro era o clássico jogo Pong, que simula uma partida de tênis; a incerteza se referia à posição da bola. Em ambos os casos, o agente performou melhor do que abordagens clássicas envolvendo inteligência artificial, mostrando que os sistemas conseguiram integrar as incertezas no processo de tomada de decisão, alcançando seu objetivo adequadamente.

O maior diferencial do trabalho é que as incertezas não precisam estar presentes nos dados de treinamento, o que seria em grande parte inviável dada sua natureza praticamente ilimitada; o próprio sistema é capaz de aprender a considerá-las seja por perturbações introduzidas artificialmente, seja encontrando-as durante sua operação. Apesar de o método apresentado servir por enquanto mais como prova de conceito, os pesquisadores esperam que novos desenvolvimentos permitam que, no futuro, robôs possam administrar com segurança as interações imprevisíveis que devem realizar com o mundo real.