Nos últimos anos, várias técnicas baseadas em inteligência artificial apareceram com o objetivo de gerar o que a área chama de talking head models, ou modelos de cabeça falante: avatares foto-realistas que sintetizam sequências de vídeo imitando as expressões faciais de um indivíduo particular. Em princípio, essa tarefa é difícil de implementar por dois motivos principais. Em primeiro lugar, cabeças humanas têm alta complexidade fotométrica, geométrica e cinemática, que derivam não só do rosto, mas também da boca, do cabelo e das roupas. Em segundo, nosso sistema visual parece ser especializado em captar as menores estranhezas na animação de rostos, o que nos faz exigentes na avaliação do realismo de modelos gerados artificialmente. Os modelos de machine learning mais consolidados têm considerado esses problemas usando técnicas que “torcem” imagens, mas essas técnicas geram resultados limitados no que se refere aos movimentos que são capazes de simular. Abordagens mais recentes usam redes neurais convolucionais do tipo adversarial, mas essas redes costumam ser enormes, e cada cabeça falante tem milhões de parâmetros para serem calibrados, o que exige uma quantidade grande de imagens e considerável capacidade computacional. Ou seja, as técnicas atualmente à disposição não atingem um patamar prático de aplicabilidade. Para que tenhamos avatares foto-realistas em teleconferências ou salas de chat, por exemplo, novas técnicas são necessárias.

Em um artigo publicado no dia 20, uma equipe conjunta do Samsung AI Center e do Instituto de Ciência e Tecnologia de Skolkovo apresentou seu trabalho que envolve o uso de redes neurais recorrentes adversariais para gerar, de forma simplificada, modelos de cabeça falante a partir de poucas (few-), ou até mesmo apenas uma (one-shot learning), imagem estática. O sistema alcança essa habilidade através de um extenso pré-treinamento, chamado de meta-aprendizagem, onde usa um coleção grande de vídeos contendo pessoas diferentes com aparência diversa. Nessa etapa, as imagens passam por um embedder extrator de características que gera vetores contendo as posições críticas (landmarks) das expressões faciais. Em paralelo, o sistema simula tarefas de few-shot learning passando algumas das imagens de treinamento por um gerador, com arquitetura convolucional, que usa os landmarks de interesse para gerar uma imagem sintética. Numa última etapa, um discriminador compara a imagem sintética com a verdadeira, que contém os mesmos landmarks, para determinar um score de realismo e assim quantificar o erro. Dessa forma, o sistema aprende a transformar posições críticas da imagem em fotografias personalizadas realistas. Finalizado o treinamento, é possível passar fotos inéditas ao sistema, que rapidamente converge ao estado capaz de gerar imagens com alta qualidade de verossimilhança.

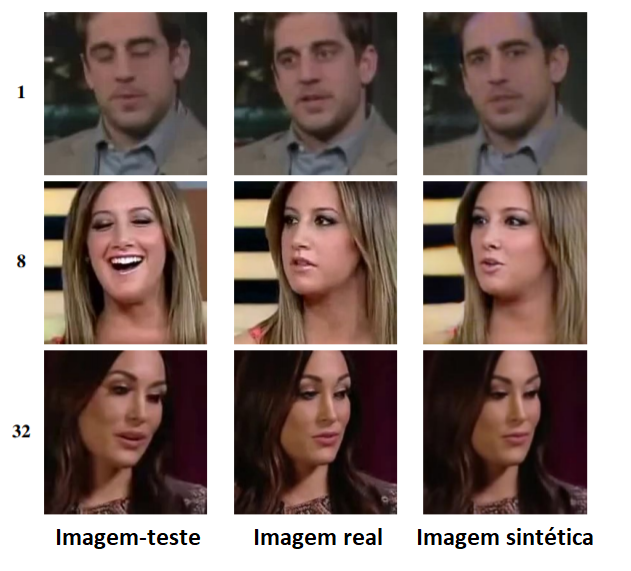

Para testar a abordagem, os pesquisadores usaram primeiro dois bancos de dados contendo vídeos de celebridades. Os vídeos artificiais foram gerados usando 1, 8 ou 32 imagens. Além de métricas objetivas, o resultado também foi avaliado por pessoas que deviam julgar a veracidade dos vídeos. A avaliação subjetiva dos resultados foi melhor do que em comparação aos outros métodos disponíveis na literatura. Apesar de os experimentos baseados em apenas uma imagem terem tido desempenho alto, os resultados são realmente impressionantes quando o número de imagens é maior.

Numa última avaliação, os autores usaram um único exemplar de imagens famosas, como fotos antigas ou quadros, para gerar pequenos vídeos copiando as expressões faciais extraídas de um vídeo real, tarefa conhecida como ventriloquismo. Os resultados, incluindo uma Monalisa falante, podem ser vistos no vídeo abaixo a partir de 4:17.

Apesar das limitações – é muito mais difícil transferir landmarks faciais para modelos de rosto muito diferentes -, os autores enfatizam que, para aplicações mais imediatas como animar a própria fotografia, a abordagem já alcança um alto grau de realismo.

Que venham os avatares animados.